未来への展望:AIの普及はメンタルヘルスに何をもたらすか

10月10日、世界は暦の上で重要な日を迎える:世界メンタルヘルス・デーである。この日は、人工知能が私たちの生活、特にメンタルヘルスに与える影響について考える絶好の機会となる。

近年、AIはメンタルヘルス研究、診断、治療の分野で目覚ましい進歩を遂げている。これらの進歩は、メンタルヘルスの問題を評価しケアする方法に革命をもたらす可能性を秘めている。

しかし、このような有望な展望には、独特の注意点や懸念がつきまとう。メンタルヘルスにおけるAIの多面的な役割、その約束と危険性を理解する旅に出よう。

メンタルヘルス研究におけるAI

近年、AIは医療へのアプローチやメンタルヘルス問題の理解に革命をもたらしている。EHR、医療画像、臨床記録などのデジタル化された医療データを活用することで、AIベースのソリューションは、ルーチン・タスクの自動化、臨床医へのサポート、メンタルヘルス障害に対するより深い洞察の獲得を支援する。

AIが躍進している注目すべき分野のひとつに、認知症診断がある。ケンブリッジ大学とアラン・チューリング研究所の研究者たちは、認知症に関連する認知機能低下の初期兆候を検出するために設計された予測・予後機械(PPM)を開発し、この技術革新の最前線にいる。このプロジェクトの最終目標は、PPMを、認知機能検査のような侵襲性の低いデータソースを利用し、診断プロセスをより患者に優しいものにする、完全に配備可能な臨床意思決定支援システムに変えることである。

この革新的なアプローチは、侵襲的な処置を最小限に抑え、医療資源配分を最適化することで、患者の幸福度を高める。その結果、AI主導のシステムは、医師が的確な診断と治療の決定を下すのを支援し、医療費を削減し、先進的な認知症治療の開発を促進する可能性がある。

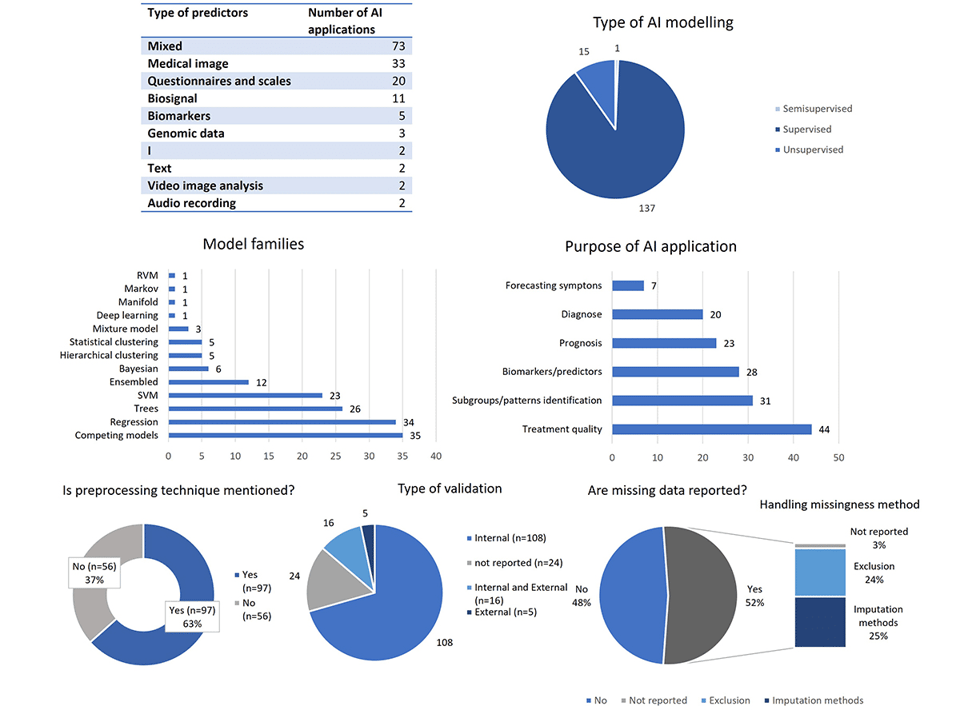

しかし、メンタルヘルス研究にAIを取り入れることに批判がないわけではないことを認めることは極めて重要である。スペインのバレンシア工科大学の専門家がWHOと共同で実施した「メンタルヘルス研究における人工知能の使用における方法論的および質的欠陥:システマティックレビュー」と題する最近の研究では、2016年から2021年にかけてのメンタルヘルス障害研究へのAIの使用を批判的に検証している。

本研究の結果は、メンタルヘルス研究におけるAIの適用における方法論的および質的欠陥を浮き彫りにした。主にうつ病性障害、統合失調症、その他の精神病性障害の研究におけるAIの偏った使用に関する懸念が指摘された。さらに、本研究は、AI研究コミュニティ内の透明性、データ検証、協力に関する問題を提起した。

メンタルヘルス診断におけるAI:PTSDの場合

心的外傷後ストレス障害(PTSD)は、世界中で数百万人が罹患している疾患である。しかし、PTSDを正確かつ効率的に診断することは長年の課題であった。幸いなことに、人工知能と機械学習における最近の進歩が、より効果的なPTSD診断への道を開きつつある。

2019年、ニューヨーク大学ランゴーン・ヘルスの研究者たちは、PTSDの診断に人工知能を活用することで大きく前進した。彼らの最初の研究では、PTSDと診断された退役軍人と診断されていない退役軍人の発声パターンを調べた。その結果、アルゴリズムはPTSDに関連する発声の特徴を89%という驚異的な精度で特定した。2つ目の研究では、PTSDの潜在的な血液マーカーを発見するためにAIを活用した。この画期的な研究は、PTSDスクリーニング血液検査の可能性への扉を開いた。

先月、41の研究の包括的な統合とレビューが行われ、PTSD診断を変革するAIの可能性に光が当てられた。このレビューで分析された研究は、AIがPTSD診断アプローチの精度と有効性を大幅に改善できることを示している。神経画像技術、構造化された臨床面接、自己報告式質問票から、ソーシャルメディア分析やバイオマーカー同定のような革新的なアプローチまで、AIはPTSDを特定し対処する方法を根本的に改善する可能性を示している。

この分野での目覚ましい進歩にもかかわらず、いくつかの障壁が、PTSDの早期診断におけるAIの臨床的な普及と可能性の実現を妨げている。診断目的のために機密性の高いデータを使用することは、患者の守秘義務やデータの安全性に関して重要な問題を提起するため、倫理的およびプライバシーに関する考慮が最も重要である。さらに、精神医療におけるAIの倫理的かつ責任ある利用を確保するためのガイドラインの必要性にこの分野が取り組んでいるため、標準化された規制がないことが課題となっている。

メンタルヘルス治療におけるAIの活用

ハーバード大学医学部とクイーンズランド大学が共同で実施した世界的な研究により、世界人口の50%が75歳までに少なくとも1つの精神障害に遭遇することが明らかになった。

世界的なメンタルヘルス障害の驚異的な蔓延を考えれば、近年、人工知能の力を活用したメンタルヘルス・ツールの開発が急増しているのは驚くことではない。

メンタルヘルスケアのためのAIベースのアプリ

アンメット・メンタルヘルス・ニーズという差し迫った問題に対し、AIを活用したメンタルヘルス・アプリがそのギャップを埋めるべく動き出している。これらのアプリは、高度なアルゴリズムとデータ分析を活用し、従来の対面療法にとどまらず、メンタルヘルスケアへのアクセスを拡大している。

こうしたAIベースのソリューションの中には、Mindmate、Endel、BetterHelp、Talkspace、Wysaといったプラットフォームがある。例えばWysaは、AIが誘導するメンタルヘルス支援システムとして機能し、メンタルヘルスケアの初期段階として機能する。このアプリは自然言語を使ってユーザーの精神状態に関する会話に参加させ、不安を軽減し思考パターンを再構築するための解決策を提供する。リラクゼーションや深呼吸などのテクニックが提供され、個人と利用可能なメンタルヘルスケア資源との橋渡しをする。

音は、その没入的な特質から、文化や時代を超えて認識されてきた変容力を秘めている。音には、睡眠、気分、集中力、血圧などに影響を与える力があります。このことを認識し、エンデルは最先端のAI技術と組み合わせた音の変容力を利用している。ユーザーの環境やニーズに合わせて、リアルタイムでパーソナライズされたサウンドスケープを作り出します。リラックスしたいとき、集中したいとき、眠りにつきたいときなど、エンデルのAI駆動型サウンド環境は、その瞬間に最適な聴覚体験を提供するよう適応し、ユーザーをグラウンディングさせ、より良いメンタルヘルスを促進します。

Rask AI:2023年から24年にかけて、人々が精神的な健康を維持するためにどのようなアドバイスができますか?

メンタルヘルスのためのウェアラブルAI

従来のメンタルヘルス評価方法からのパラダイムシフトとして、AIを活用したメンタルヘルスソリューションの中には、センサーを介して身体信号を解釈するウェアラブルデバイスの測定値に依存するものがある。Apple Watchのようなウェアラブルデバイスは、従来のアンケートや対面評価を必要とせずに、心理状態を遠隔評価するユニークな機会を提供する。

マウントサイナイのHasso Plattner Institute for Digital HealthのRobert P. Hirten博士が主導したこの研究の目的は、"ウェアラブルデバイスから受動的に収集された生理学的指標から、個人の心理的レジリエンスの程度を判定できるかどうかを評価する "ことであった。利用されたデータセットは、心拍変動と安静時心拍数を継続的に測定するApple Watch Series 4または5のデバイスを装着した329人の医療従事者で構成された。同時に、レジリエンス、楽観主義、感情的サポートを測定するための調査が行われた。

研究者らは、機械学習モデルを用いてこの豊富なデータを分析し、個人のレジリエンスレベルと心理的幸福度を予測した。この発見は、ウェアラブルからのデータを使って心理的特性を評価することの実現可能性を指し示すものであり、メンタルヘルス評価における極めて重要な進歩である。

メンタルヘルス・セラピーにおけるAI:変革をもたらすソリューション...

メンタルヘルス治療に人工知能の力を活用することは、多くの利点をもたらす。網羅的なリストではないが、メンタルヘルスケアにAIを組み込むことに関する複数の関連研究や研究論文で言及されている主なプラス面をいくつか紹介する:

- 偏見を減らす。AIを搭載したバーチャルセラピストやチャットボットは、他の人間に自分の状態を明かすことなく助けを求めることを可能にし、控えめなメンタルヘルスサポートを提供する。

- アクセシビリティの向上。うつ病や自閉症のような症状は、人との交流を困難にする可能性がある。AIは、アプリやチャットボットを通じてサポートや診断、治療の選択肢を提供することができ、人との対話が苦手な人にとってより利用しやすくなる。

- 効果的なコミュニケーションバーチャル・インタビュアーやロボット・セラピストは、患者に病状について打ち明けるよう促し、トークセラピーへの関与を向上させることに有望である。特にPTSDのようなケースでは、コミュニケーションギャップを埋めることができる。

- 人材不足への対応。メンタルヘルスの専門家が世界的に不足している中、AIが診断、治療、支援に乗り出すことができる。アプリやチャットボットは、必要としている個人にアプローチし、メンタルヘルスケアをより多くの人々に広げることができる。

- バイアスの軽減。AIは、症状、遺伝学、ウェアラブルデータを含む幅広い要素を考慮することで、公平な診断を提供することができる。これにより、診断プロセスにおける人間のバイアスの影響を軽減することができる。

- コンプライアンスの強化。AIは、リマインダー、追跡、パーソナライズされた介入を通じて、患者が治療計画を確実に遵守するよう支援し、より効果的な転帰につなげることができる。

- 個別化された治療。AIは、症状や治療反応を継続的にモニタリングすることで、様々な精神疾患の治療計画をオーダーメイドできる可能性を提供する。

それとも地雷の可能性?

医療分野では、人工知能が私たちの注意を必要とする落とし穴を 伴うことは周知の事実である:

- 診断の複雑さ。精神疾患は複雑であり、診断のための客観的な数値データが不足していることが多い。AI研究の多くはレトロスペクティブであり、外部からの検証を欠いているため、診断の正確性や信頼性に疑問が投げかけられている。

- プライバシーとデータの悪用。AIのデータ収集能力は、個人の健康データが第三者による追跡や悪用に対して脆弱である可能性があるため、プライバシーに関する懸念を引き起こす。患者データの保護は最も重要であるが、AI主導の状況では難しい。

- バイアスの増幅。AIアルゴリズムは、学習データに存在するバイアスを永続させる可能性があり、それがメンタルヘルス治療における差別的な結果につながり、既存の格差を悪化させる可能性がある。

- 過剰な機械化。洗練されたAIツールは、過剰な機械化をもたらし、人間によるケアが自動化に取って代わられる危険性がある。医療において人間味を維持することは、患者の幸福のために不可欠である。

- 規制上の課題。包括的な規制ガイドラインがないため、ヘルスケアにおけるAIアプリケーションの監督には大きな課題がある。

- 患者と医療者の関係。AIツールへの過度の依存は、患者と医療者の関係を緊張させ、テクノロジー中毒を引き起こし、対面医療サービスへのアクセスを減少させる可能性がある。

職場におけるAI:メンタルヘルスへの影響

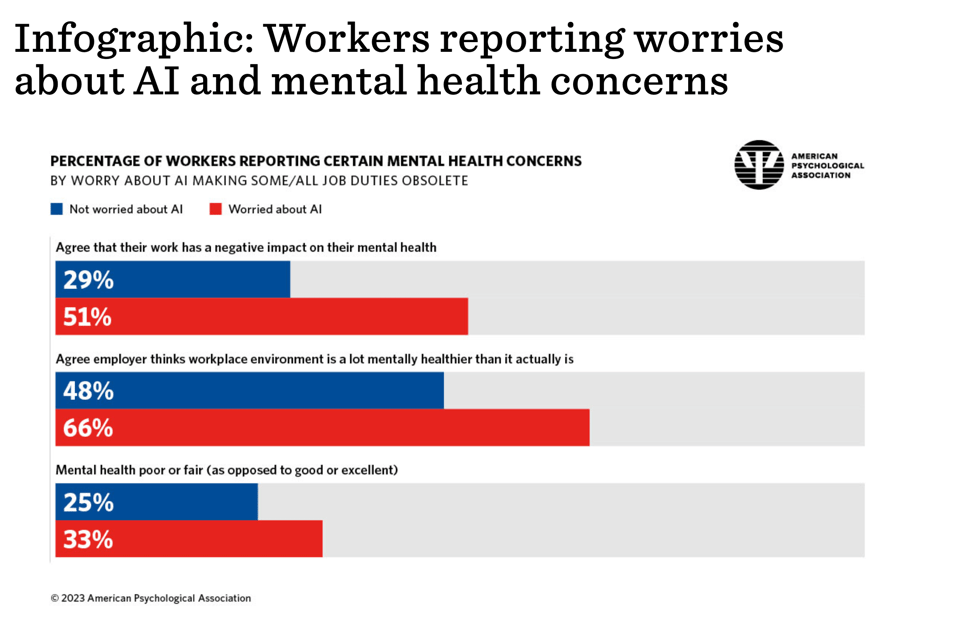

職場におけるAIの存在感の高まりは、従業員の間に理解できる懸念を促し、しばしば "AI不安 "と呼ばれる現象を巻き起こしている。APAの2023年ワーク・イン・アメリカ調査では、こうした不安と従業員の心理的幸福との間に注目すべき関係があることを強調している。労働者の約38%が、AIによって自分の仕事の一部または全部が陳腐化する可能性について懸念を表明している。憂慮すべきことに、こうした不安は、精神的・感情的な幸福の低下を示す指標と相関している。

AIを心配する人々は、メンタルヘルスに悪影響を及ぼすと報告する傾向が高く、職場は認識されているよりも精神的に健康でないと考え、一般的な精神的健康状態は悪いかまあまあと表現した。さらに、これらの懸念は、評価されていないという感情、マイクロマネジメント、テクノロジーが自分の役割を引き継ぐことへの懸念と関連していた。

国民の意見

一般の人々はどうだろうか?メンタルヘルスケアへの人工知能の統合に関する一般市民の意見には、不安と期待が入り混じっている。

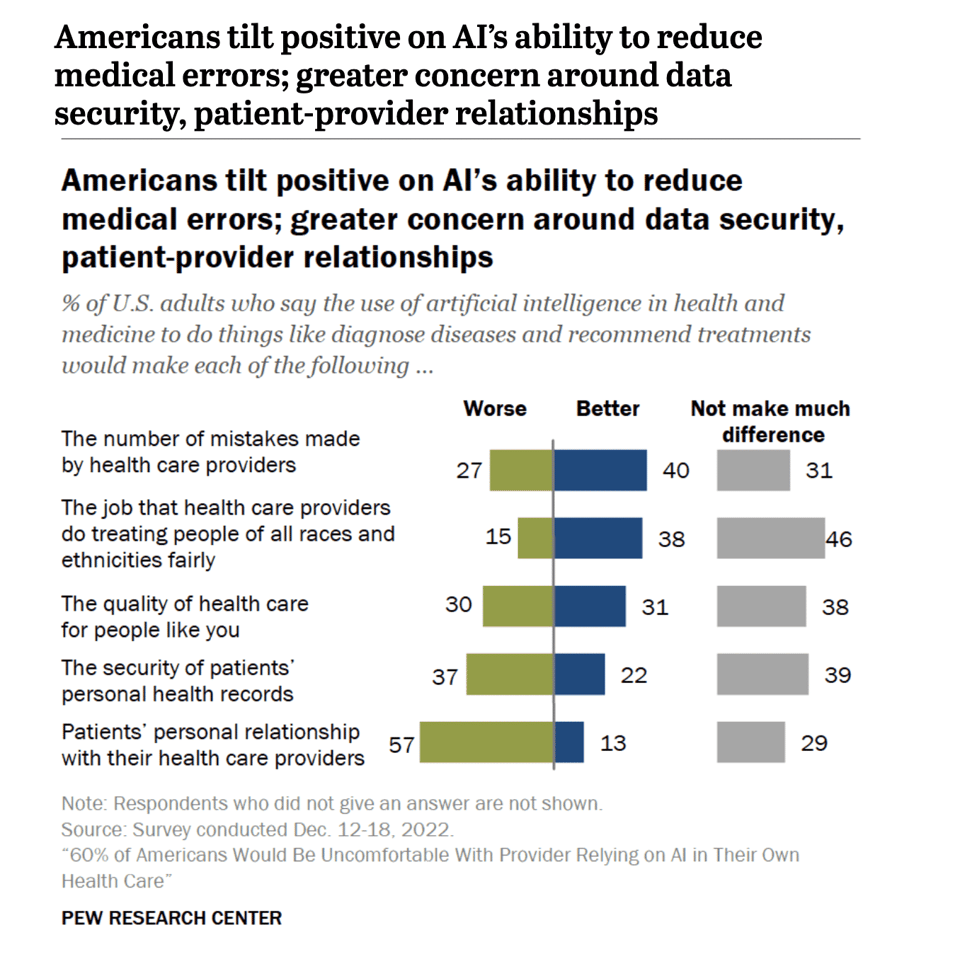

ピュー・リサーチ・センターが最近実施した調査では、健康や医療におけるAIの役割について、メンタルヘルスへの潜在的な影響も含めて、アメリカ人の感情を掘り下げた。その結果、AIが自分たちのヘルスケアに関与することに関して、国民の間に大きな不快感があることが明らかになった。米国の成人の約60%が、病気の診断や治療法の推奨といった業務において、医療提供者がAIに頼るという考え方に不安を表明しており、この見通しに安心感を抱いていると回答したのはわずか39%だった。

このような感情に影響を与えている要因のひとつは、AIが健康上の成果を向上させる能力について、一般の人々が懐疑的であることだ。調査では、AIが病気の診断や治療法の推奨といったタスクに採用された場合、全体として患者の健康状態の改善につながると考えている人はわずか38%に過ぎないことが明らかになった。

肯定的な面では、AIを導入すれば医療従事者のミスは増えるどころか、むしろ減ると考える人の方が多かった(40%対27%)。さらに、医療における懸念事項として人種的・民族的偏見を挙げた人のうち、AIがこの問題を改善する可能性があると予想する人が過半数を占め、51%が改善につながると考えているのに対し、問題を悪化させる可能性があると考える人は15%だった。

さらに、医療と健康におけるAIの統合は、患者の記録の安全性を損なう可能性があると考える人が37%いる一方で、安全性を強化するものであると考える人が22%と、反対の意見を持っていることから、安全性への懸念が浮かび上がった。これらの対照的な見解は、メンタルヘルスケアにおけるAIの役割をめぐる世論の複雑な性質を浮き彫りにしている。

思考の糧

Rask AI:来たる「こころの健康デー」を踏まえ、AIが精神的な幸福を阻害するのではなく、むしろ利益をもたらすよう、AIをバランスよく活用するための重要なメッセージや提言は何でしょうか?

AI開発者は、透明性、プライバシー、信頼性を優先したユーザー中心の設計でシステムを構築する義務を負う。AIを職場に導入する雇用主は、心理的な悪影響がないか注意深く監視しながら、従業員がこの進化する技術的状況をナビゲートするための適切なトレーニングとサポートを受けられるようにしなければならない。規制機関は、AIの開発と配備を管理する基準とガイドラインを確立し、個人の心理的福祉を守る上で極めて重要な役割を果たす。

しかし、より広範な責任は、AIがメンタルヘルスに及ぼす深刻な影響を総合的にナビゲートする社会そのものに及ぶ。開かれた対話に参加し、倫理的なAIの実践を提唱し、個人の権利と幸福を支持する政策を提唱することは、すべて私たちが社会としてなしうる本質的な貢献である。

賛成ですか、反対ですか?メンタルヘルスの分野におけるAIの応用について、ぜひご意見をお聞かせください。共有したいストーリーがありましたら、[email protected]までご連絡ください。

AIが生活の概念そのものを変えつつあることについての洞察はこちらでお読みください。

Rask%20Lens%20A%20Recap%204.webp)